Google tekee tekoälymallit läpinäkyviksi – Kertoo miksi lääkäri näyttää lääkäriltä

Tekoälyn hyödyntämisen yksi isoista eettisistä kysymyksistä on, että miten käytettävät mallit koulutetaan ja minkälaisia vinoumia niihin saattaa tämän seurauksena syntyä. Ongelman ratkaiseminen ei ole erityisen helppo, sillä tekoälymallien tarkkaa päättelyketjua ei välttämättä tunneta.

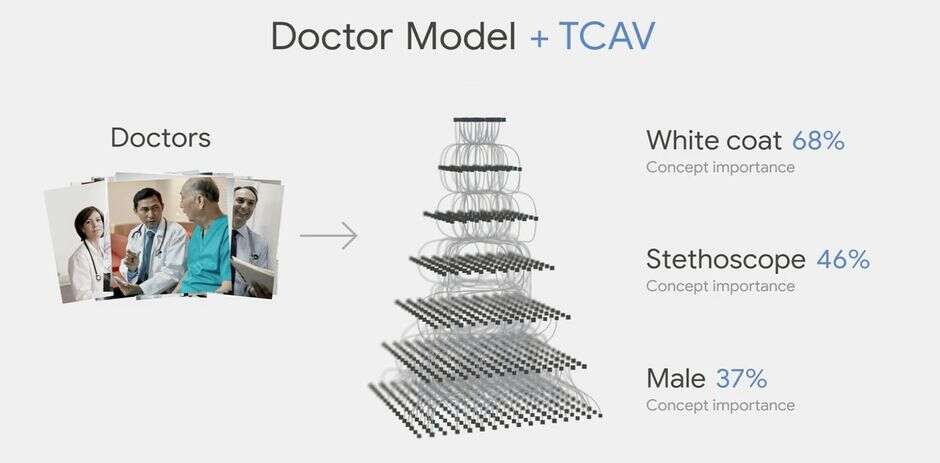

Google on kuitenkin ottanut härkää sarvista ja aikoo tehdä läpinäkyväksi sen, miten yhtiön tarjoamat mallit päätyvät tuloksiin. Uuden TCAV-nimisen (Testing with Concept Activation Vectors) teknologian avulla Google kertoo prosenttiosuuksin sen, kuinka paljon tietyt asiat vaikuttivat päädyttyyn lopputulokseen. Esimerkiksi kuvantunnistustehtävässä Googlen konenäkömalli voisi kertoa kuvassa olevan lääkäri ja TCAV kertoo, että päättelyketjuun vaikutti eniten henkilön käyttämä valkoinen takki ja se, että kuvassa on mies.

Juuri viimeksi mainitun kaltaisia asioita Google haluaa TCAV:lla tuoda ilmi. Esimerkin tapauksessa konenäkömallissa on sukupuolivinouma, jossa oletetaan lääkäreiden olevan miehiä. Tiedon avulla mallia voidaan korjata, mutta yleisestikin se antaa tärkeää tietoa miten malli toimii, jolloin voidaan ymmärtää miksi malli toimii tai miksi se ei tietyissä tapauksissa toimi halutulla tavalla.

TÄMÄN UUTISEN KOMMENTOINTI ON PÄÄTTYNYT